从并发编程到分布式系统 海量数据处理的技术演进与实践

在当今数据驱动的时代,企业和组织面临着海量数据的处理挑战。从单机并发编程到大规模分布式系统,数据处理技术经历了显著的演进,不仅提升了处理效率,也扩展了应用的边界。

一、并发编程:高效利用单机资源

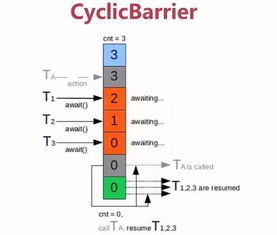

并发编程是数据处理的基础,通过多线程、异步IO等技术,充分利用多核CPU和内存资源,提升单机系统的吞吐量。例如,Java的并发包(java.util.concurrent)提供了丰富的工具类,如线程池、锁机制和并发集合,帮助开发者编写高效、安全的并发程序。在处理海量数据时,并发编程可以加速数据加载、转换和聚合等操作,但受限于单机硬件瓶颈,难以应对TB级以上的数据规模。

二、分布式系统:突破单机限制

随着数据量的爆炸式增长,分布式系统成为处理海量数据的核心方案。通过将任务分解到多个节点并行执行,分布式系统能够水平扩展,支持PB级数据的存储和计算。关键技术包括:

- 分布式存储:如HDFS(Hadoop分布式文件系统)和云存储服务,提供可靠的数据持久化。

- 分布式计算框架:例如Apache Spark和Flink,支持内存计算和流处理,大幅提升处理速度。

- 资源管理:像Kubernetes和YARN这样的调度器,优化集群资源分配,确保任务高效运行。

三、实践案例与挑战

在实际应用中,从并发编程到分布式系统的过渡并非一蹴而就。以电商平台为例,初期可能使用多线程处理用户请求和日志数据;当数据量激增后,需迁移到分布式架构,如采用Spark进行实时推荐分析。挑战包括数据一致性、网络延迟和故障容错,解决方案包括分布式事务协议(如两阶段提交)和副本机制。

四、未来展望

海量数据处理将继续融合人工智能和边缘计算,推动实时性和智能化发展。例如,联邦学习结合分布式系统,在保护隐私的同时处理分散数据。开发者需掌握并发编程基础,并深入学习分布式原理,以适应不断演进的技术需求。

从并发编程到分布式系统,数据处理技术的演进体现了计算资源的优化与扩展。通过合理选择架构和工具,企业能够高效应对海量数据,释放数据价值,驱动业务创新。

如若转载,请注明出处:http://www.chinaapmdata.com/product/19.html

更新时间:2026-06-01 14:20:53